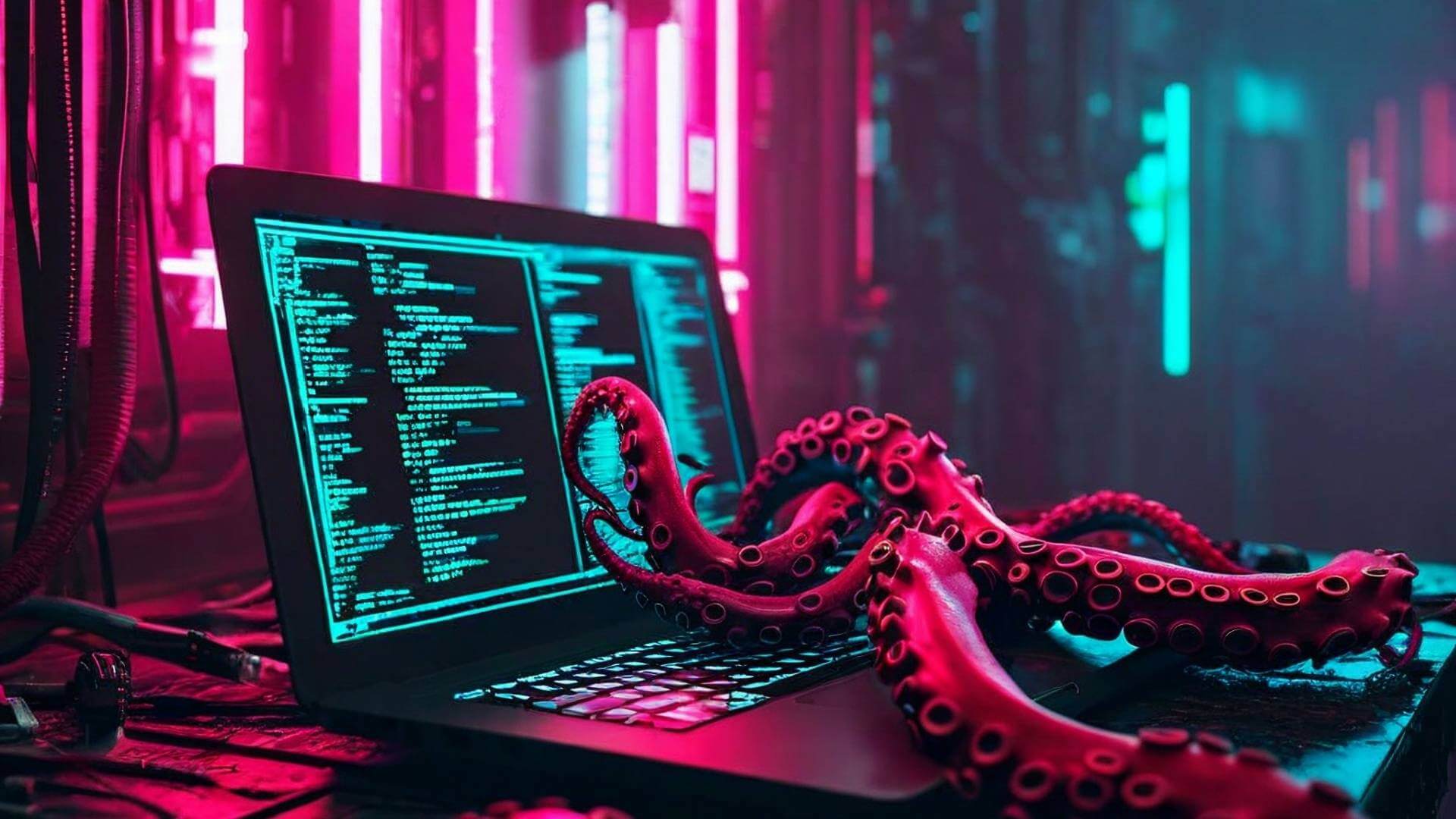

IA sotto attacco: salvare modelli e dati dal prompt injection persistente

Le tecniche di prompt injection persistente minacciano i modelli linguistici generativi, aggirando i filtri di sicurezza. Il GDPR mostra limiti strutturali, ma le soluzioni legal tech possono offrire strumenti di controllo, tracciabilità e audit preventivo efficaci contro queste vulnerabilità emergenti L'articolo IA sotto attacco: salvare modelli e dati dal prompt injection persistente proviene da Agenda Digitale.